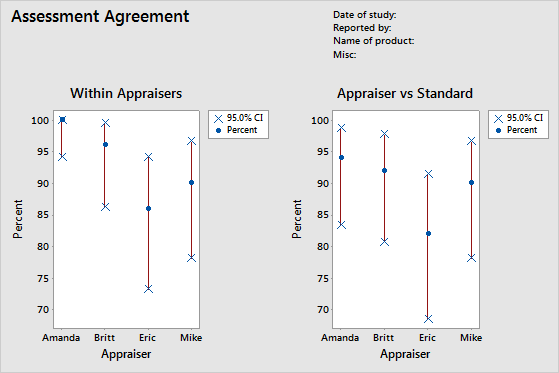

Variabilidad Interobservador del Score SYNTAX en pacientes con diagnóstico de Enfermedad Arterial Coronaria Multivaso. | Naranjo Dominguez | Revista Cubana de Cardiología y Cirugía Cardiovascular

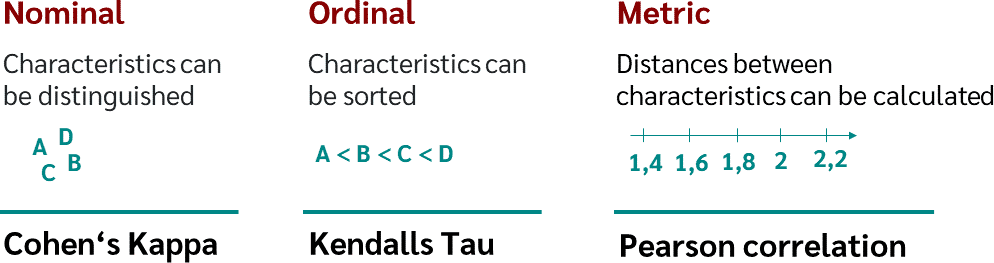

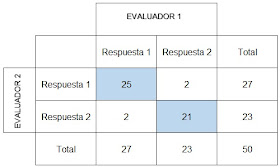

Corelab on Instagram: “El coeficiente kappa de Cohen es una medida estadística que se utiliza para medir el nivel de acuerdo entre dos evaluadores o jueces que…”

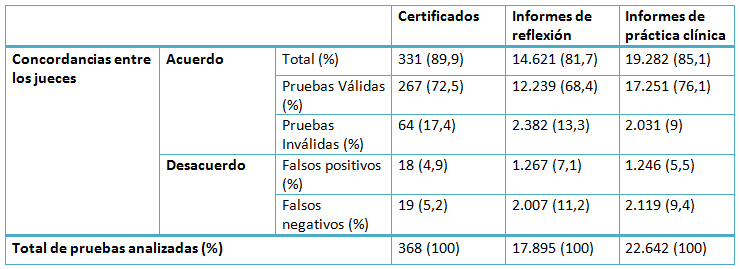

Fiabilidad inter-jueces en evaluaciones portafolio de competencias profesionales en salud: el modelo de la Agencia de Calidad Sanitaria de Andalucía - Medwave